¿Qué es?

El nombre de capitalismo de la vigilancia surge de las investigaciones que la filósofa y economista Shoshana Zuboff ha ido desarrollando en diversos artículos y que cristalizan en su libro de 2019 The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of Power (‘La era del capitalismo de la vigilancia: la lucha por un futuro humano en la nueva frontera del poder’).

Según Zuboff, se trata de una nueva forma de capitalismo que deriva de la economía de la atención. Ante un internet gratuito, las empresas han de buscar nuevos modelos de negocio. Así, recopilan datos sobre los gustos e intereses de los usuarios que usan para construir modelos computacionales para predecir sus acciones y ofrecer publicidad personalizada.

Para la autora, este nuevo modelo de capitalismo no tiene precedentes, es especialmente dañino y, si no se reacciona a tiempo, la misma idea de libertad humana está en peligro.

Formas de aplicación

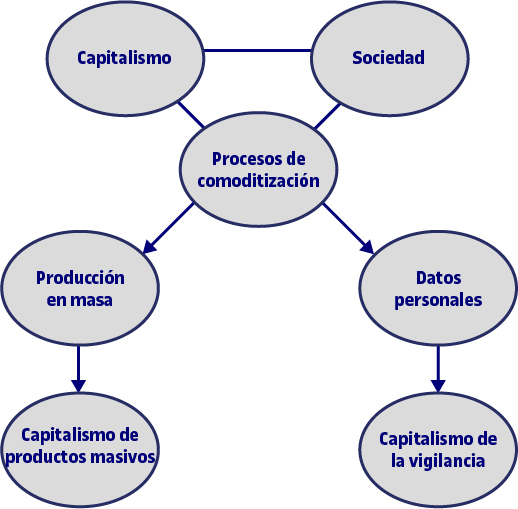

En cuanto a fuerza económica, este nuevo capitalismo busca, como los otros capitalismos, nuevos campos de expansión para intentar capturar objetos y tendencias que estén actualmente fuera del ámbito del mercado y convertirlos en commodities, es decir, productos que pueden comprarse y venderse.

El capitalismo es así capaz de capturar tendencias que irían en su contra y darles la vuelta hasta convertirlas en productos comercializables. Movimientos inicialmente contraculturales, como el hippismo o el punk, acaban convirtiéndose en una estética que ofrece todo tipo de productos a la venta, y buena parte de los que compran esos productos acaban olvidando las raíces críticas anticapitalistas que los habían generado inicialmente. Un ejemplo sería la canción punk «Should I Stay or should I Go» de The Clash, utilizada en anuncios de tejanos.

Para Zuboff, sin embargo, el capitalismo de la vigilancia incluye un nuevo movimiento radicalmente diferente y problemático: convertir las experiencias subjetivas y privadas en productos comercializables y desarrollar predicciones personalizadas del comportamiento de los usuarios para ampliar su capacidad de influir y modificar sus vidas.

Aparece así un nuevo mercado que Zuboff llama productos de predicción, donde la commodity es nuestra propia subjetividad, y existen mecanismos para modificar las creencias y deseos de los usuarios en beneficio de grandes empresas.

Esta nueva versión del capitalismo es para Zuboff especialmente dañina, porque convierte nuestra subjetividad y privacidad en productos comercializables y genera graves erosiones en nuestros derechos, ya que datos privados como las preferencias sexuales o las preocupaciones sociales y políticas se venden a terceros. Además, el fenómeno no termina aquí: la misma idea de libertad de elección está en peligro cuando se pueden crear poderosos mecanismos de persuasión personalizados que inciden directa o indirectamente en la forma en que valoramos datos para tomar una decisión (véase el contenido dedicado a la persuasión).

No es necesario ser deterministas y pensar que Facebook y Google tienen control total sobre nuestra toma de decisiones. Es suficiente con darse cuenta de que el capitalismo de la vigilancia tiene una imagen de la subjetividad de las personas como un producto comercializable y que ello es incompatible con conceptos éticos básicos como la autonomía y dignidad de todas las personas.

¿Cómo afecta al diseño?

El diseño de interacción es una parte central de este nuevo capitalismo de la vigilancia. Es un error pensar que simplemente se crea publicidad y que la única diferencia es que ahora la publicidad, en lugar de dirigirse a grandes grupos tipo, está personalizada en base a nuestros gustos y aficiones. En realidad, se está colaborando con un sistema en el que preferencias, valores y deseos se convierten en mercancía. El diseñador debería reflexionar sobre de qué forma un proyecto en el que participa está conectado o no con ese nuevo paradigma.

El determismo tecnológico es una posición filosófica que defiende que las implicaciones éticas, culturales y sociales de una tecnología vienen predeterminadas por la estructura de funcionamiento de esta y son, por tanto, inalterables. Según esta posición, la forma en que se organizan las tecnologías digitales implica, de manera automática e inevitable, el almacenamiento y procesamiento de datos de índole personal. Sin estos mecanismos de almacenamiento y procesamiento, no tendríamos las poderosas y vibrantes tecnologías que nos acompañan.

Para Zuboff, sin embargo, esto es un grave error categorial. Es importante ser consciente de que estos mecanismos de captura y procesamiento de información personal no son el resultado inevitable de un tipo de tecnología, sino decisiones conscientes y diseñadas. Como bien argumenta Zuboff en su libro, no es el motor de búsqueda de Google en sí el que obtiene y procesa información personal, sino que son los comités de accionistas de las grandes empresas, como Google y Facebook, los que quieren esa información porque operan en el modelo comercial del capitalismo de la vigilancia.

No hay ninguna razón técnica por la que un buscador tenga que recopilar datos personales sobre los usuarios. El motor de búsqueda de Google no se basaba originalmente en gestionar información personal y en la creación de perfiles. Brin y Page deciden desarrollar el modelo de publicidad personalizada en Google, y todo lo que ello comporta, como consecuencia de su modelo de negocio. Existen buscadores como DuckDuckGo o Ecosia que no se basan en un modelo de publicidad personalizada y, por tanto, no erosionan la privacidad.

Es importante no caer en el error contrario y creer que estos abusos de poder no dependen en absoluto de la tecnología. Según esta visión, Facebook no es ni bueno ni malo, el problema son las decisiones concretas erróneas tomadas por Zuckerberg o sus asesores. Es necesario insistir en que Facebook, Google, Amazon, Twitter, etc., usan tecnologías diseñadas con unos objetivos muy concretos de sus directivos y accionistas que están basados en la lógica del capitalismo de la vigilancia.

Finalmente, también sería un error pensar que la única forma de sobrevivir como diseñadores de interacción es como asalariados del capitalismo de la vigilancia. Zuboff no es una pensadora filocomunista que cree en la desaparición del capitalismo para sustituirlo por la dictadura del proletariado digital. Para Zuboff, el propio capitalismo tiene mecanismos para transformar el capitalismo de la vigilancia. Así, en algunos escritos contrapone la forma de entender el capitalismo de Google o Facebook —capitalismo de la vigilancia— con otras formas de capitalismo más clásicas, como la posición de Apple. Apple tiene un modelo de comercialización basado en la venta de productos físicos, como ordenadores y dispositivos móviles, y la venta de contenidos por medio de plataformas como iTunes o App Store. Al no estar asociada a un modelo comercial basado en ofrecer productos gratis, Apple no tiene que recurrir a la recopilación y procesamiento de datos personales y privados como motor de negocio. De ahí que ofrezca sistemas para el cifrado seguro de información —llegándo incluso a enfrentarse al FBI al negarse a descrifar la información en el iPhone de un presunto terrorista. Es importante no reducir esto a una cuestión de buenos y malos: ni Apple es un ángel, ni Google es el demonio. Son empresas que se guían por diferentes paradigmas de qué es el capitalismo.

Algunos autores, como Morozov en su reseña del libro de Zuboff, disienten de esta lectura y argumentan que en realidad no ha cambiado nada. La explotación del mundo privado ha existido siempre en el capitalismo. No hay diferentes tipos de capitalismo, sino el mismo mecanismo básico de intentar comoditizar nuevos mercados. El capitalismo de la vigilancia es simplemente otra forma más de explotación. Según estos autores, el capitalismo de la vigilancia no es el problema, sino que el problema es el capitalismo.

Actualmente, el capitalismo de la vigilancia está detrás de la mayoría de productos digitales, de manera que es muy probable que un diseñador de interacción se cruce con él en su ejercicio profesional. El diseñador ha de tener en cuenta las implicaciones que su trabajo tendrá en los usuarios. Por ejemplo, el equipo de diseñadores que trabajaba para Cambridge Analytica creó noticias falsas asociadas a perfiles para convencer a personas de que su mejor opción política era votar a favor de que el Reino Unido saliera de la Unión Europea. ¿Es esa una tarea acorde con los valores de la profesión del diseñador de interacción? Las respuestas no son nunca sencillas, pero es importante reflexionar sobre la situación en la que vivimos ahora y decidir si queremos ser parte de la solución o parte del problema.

¿Cómo afecta a la interacción con el usuario?

Según Zuboff, el capitalismo de la vigilancia está extendiendo sus tentáculos más allá de internet y cada vez controla más aspectos de nuestras vidas. De nuevo, es una consecuencia de la forma en la que el capitalismo actúa. El capitalismo de la revolución industrial trajo la idea de producción en masa y este paradigma se describe genéricamente bajo el nombre de fordismo, en relación con Henry Ford, la persona que trajo al mundo la cadena de montaje para crear automóviles en serie. El fordismo y sus metodologías asociadas se aplicaron primero a las fábricas, pero luego se fueron extendiendo a otros aspectos de nuestras vidas. Así vemos en la actualidad cómo la lógica interna de escuelas, universidades, cárceles, hospitales, etc., sigue los métodos y procedimientos del fordismo.

El capitalismo de la vigilancia sigue mecanismos similares. Se recopilan datos sobre usuarios y se utilizan para hacer predicciones con las que ofrecer o denegar seguros médicos o créditos bancarios en el desarrollo de campañas electorales o en los consejos de redacción a la hora de decidir qué noticias han de aparecer en la primera plana de un periódico.

Una cuestión central es cómo el usuario final de este sistema es totalmente inconsciente de todos estos mecanismos. Usamos Google, Facebook y otras redes sociales sin ser plenamente conscientes de que están recopilando datos sobre nosotros que se usarán para crear detallados perfiles. La información que se deja en aplicaciones sociales para encontrar pareja se revenden a terceros para que puedan fabricar sus propios sistemas de perfiles y personalización. Casi cualquier web contiene cookies que registran qué visitamos y cómo interactuamos, pero nadie parece ser consciente de este continuo proceso de minería de nuestra privaciad.

Y cuando las personas somos conscientes de estos procesos, las respuestas más comunes son, o bien despreocupación, porque «no tenemos nada que ocultar» así que es irrelevante que nos vigilen, o bien se genera un sentimiento de impotencia: no hay nada que hacer contra estas tendencias y no puedo vivir en una cueva, tengo que usar Google, Facebook y WhatsApp si quiero seguir viviendo en el siglo XXI, así que debo resignarme y dejar que me vigilen.

Para evitar todos los problemas que nos causan las tecnologías digitales basadas en el capitalismo de la vigilancia, Zuboff propone, en primer lugar, que su naturaleza básica sea conocida y divulgada entre la población, pues si no somos conscientes del problema, difícilmente tendremos interés en ponerle remedio. El siguiente paso es, en cuanto a consumidores en un mundo capitalista, votar con nuestras decisiones, es decir, si nos preocupa que empresas como Google utilicen los datos sobre nuestras búsquedas o lo que escribimos en el correo electrónico para crear perfiles sobre nosotros, podemos pasarnos a alternativas con otros modelos de negocio, como el buscador DuckDuckGo o el servidor de correo electrónico Protonmail.

También podemos reflexionar sobre nuestra actividad cotidiana en las redes sociales, pensar qué beneficios nos aporta realmente Facebook y cuánto tiempo pasamos allí y decidir que hay actividades más interesantes, creativas o formativas. Si consideramos que para nuestro trabajo las redes sociales son relevantes, podemos usar una que respete nuestra autonomía y privacidad, como Diaspora.

Diagrama

Referencias

Blasco, L. (2019). «Qué es el «oscuro» capitalismo de la vigilancia de Facebook y Google y por qué lo comparan con la conquista española». BBC News. <https://www.bbc.com/mundo/noticias-47372336>. [Fecha de consulta: 25 de enero de 2021].

Diaspora: <https://diasporafoundation.org/>. [Fecha de consulta: 25 de enero de 2021].

DuckDuckGo: <https://duckduckgo.com/>. [Fecha de consulta: 25 de enero de 2021].

Ecosia: <https://www.ecosia.org/>. [Fecha de consulta: 25 de enero de 2021].

Morozov, E. (2019). «Capitalism’s New Clothes». The Baffler. <https://thebaffler.com/latest/capitalisms-new-clothes-morozov>. [Fecha de consulta: 25 de enero de 2021].

ProtonMail: <https://protonmail.com/>. [Fecha de consulta: 25 de enero de 2021].

Zuboff, S. (2015). «Big other: surveillance capitalism and the prospects of an information civilization». Journal of Information Technology (núm. 30 (1), págs. 75-89).

Zuboff, S. (2019). The age of surveillance capitalism: the fight for the future at the new frontier of power. Profile Books.